La escasez a nivel mundial de recursos especializados en threat intelligence y security operations en los SOCs (Security Operations Centers) deja a muchas empresas expuestas al creciente peligro de un incidente de seguridad. Esto se debe a que por falta de recursos no se pueden explorar adecuadamente todas las prácticas descubiertas.

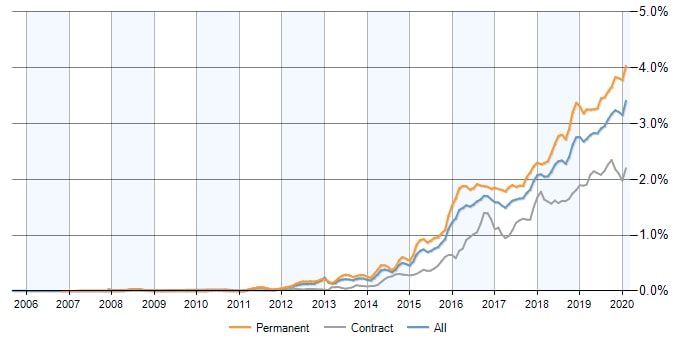

Si bien la creciente importancia de la ciberseguridad está impulsando una ola de nuevas tecnologías y desarrollos, las personas son una fuerza impulsora definitiva detrás de la protección de la ciberseguridad, y es difícil encontrar talento. Según lo indicado por la Asociación de Auditoría y Control de Sistemas de Información (ISACA), el desarrollo de trabajos de ciberseguridad está creciendo en en rangos mucho mayores a la tasa de trabajos generales de TI y para 2019 la escasez mundial de puestos de ciberseguridad superará los 2 millones. Según ESG, el 66% de los expertos en seguridad aceptan que la brecha de habilidades en ciberseguridad ha llevado a una mayor carga de trabajo para el personal existente.

A medida que las organizaciones luchan contra un grupo de amenazas externas e internas continuamente en desarrollo, la inteligencia artificial (IA), el aprendizaje automático (ML) y la automatización están desempeñando progresivamente un papel importante para detener esa brecha en la fuerza laboral. Sin embargo, ¿en qué medida pueden las máquinas respaldar y actualizar los equipos de ciberseguridad, y podrán eliminar el requisito de personal humano?

Estas preguntas surgen en la mayoría de las grandes empresas, sin embargo, el aumento de delitos cibernéticos contra organizaciones, gobiernos y personas está aumentando considerablemente. Los estudios muestran que el efecto de los ataques cibernéticos podría llegar a la alarmante cifra de 6 billones para el 2021. Además, los gastos no son sólo financieros. A medida que las organizaciones aprovechan y recolectan datos de miles de millones de personas, las interminables violaciones de datos de alto perfil han convertido la privacidad en una de las principales preocupaciones. Las reputaciones y, a veces, las vidas de las personas están en juego.

Las empresas pueden comenzar a cerrar la brecha de habilidades ampliando su fuerza de trabajo, utilizando habilidades de inteligencia artificial (IA). Sin embargo, la inteligencia artificial no se propone suplantar a las personas, sino que ofrece una increíble mezcla de hombre y máquina, destinada a mejorar el rendimiento humano. Probablemente el mejor caso de esto es el centauro versus el ajedrez de la supercomputadora. Mientras que las supercomputadoras superan a las personas en el ajedrez de manera confiable, un centauro consolida el instinto humano y la innovación con la capacidad de una computadora para recordar y determinar una gran cantidad de movimientos, contramovimientos y resultados. En consecuencia, jugadores de ajedrez novatos con ordenadores vencen a las dos supercomputadoras y los campeones de ajedrez por un gran margen.

Según el informe DBIR 2018 de Verizon, la utilización de credenciales robadas fue la estrategia más ampliamente reconocida para obtener acceso no autorizado. Ya, en la versión de 2017 de un informe similar, el 81% de todas las brechas de seguridad eran provocadas por algún tipo de actividad de comportamiento del usuario.

En cualquier caso, observar una gran cantidad de eventos de actividad del usuario al día y relacionarlos con malware es lento y tedioso, lo que provoca una alta rotación de analistas de nivel 1 en el centro de operaciones de seguridad (SOC). Dado que no todo lo sospechoso es malévolo, y la verdad es que la mayoría de las alertas son falsos positivos, el análisis de comportamiento del usuario (UEBA) utiliza inteligencia artificial para distinguir patrones y analizar irregularidades que definitivamente disminuyen la proporción de "señal a ruido", aclarando esas alertas que realmente llevan a una investigación.

Un buen método para mejorar la productividad y la eficacia de los analistas de SOC y reducir el tiempo de permanencia es introducir y utilizar la inteligencia artificial (IA) para reconocer, analizar, explorar y priorizar las alertas de seguridad. La inteligencia artificial en ciberseguridad se puede utilizar como un multiplicador de fuerza para los analistas de seguridad al aplicarla directamente al procedimiento de investigación. Mediante la utilización de métodos analíticos, por ejemplo, aprendizaje supervisado, análisis gráfico, procesos de razonamiento y sistemas automatizados de extracción de datos, los equipos de seguridad pueden reducir la investigación manual propensa a errores, hacer predicciones de resultados de la investigación (alta o baja prioridad, real o falsa), e identificar actores de amenazas, campañas, alertas relacionadas y más.

Miter ATT & CK, una estructura para la compresión de estrategias, sistemas y métodos de amenazas que dependen de las observaciones de amenazas del mundo real, está ganando terreno como el estándar para la evaluación de amenazas y la estrategia de ciberseguridad. En el momento en que se combina con el sistema Mitre ATT & CK, la inteligencia artificial proporciona datos de primera mano sobre las estrategias y fases de un ataque, agregando información y confianza a lo que la IA ha encontrado. Asimismo, acelera la respuesta, ya que los expertos tienen una comprensión inmediata de las estrategias que han empleado. Además del hecho de que esto acorta los largos períodos de trabajo por parte de analistas expertos, también garantiza que todas las alertas se examinen de manera consistente.

Otra razón por la cual la IA y ML avanzaron más rápidamente en el ámbito del fraude podría deberse a la cultura de la industria. La detección del fraude no se asociaba de forma constantemente con la ciberseguridad, sino que pertenecían a grupos independientes dentro de la mayoría de las empresas. En cualquier caso, con el crecimiento de robo de credenciales (credential stuffing) y diversos ataques, los equipos de ciberseguridad fueron incluidos de forma progresiva.

Los grupos de ciberseguridad, una vez más, han avanzado hacia los problemas con una aproximación teórica, ya que las vulnerabilidades que estaban intentando encontrar y protegerse llegaría el momento en el que se explotarían en su entorno de maneras que podrían observar. Por otro lado, los equipos de fraude comenzaron a utilizar IA y ML hace más de 10 años, mientras que los equipos de ciberseguridad han empezado a recibir soluciones basadas en IA y ML de forma reciente.

Las empresas pueden evaluar la efectividad de sus esfuerzos actuales en seguridad distinguiendo la etapa en la que se encuentra el ataque dentro de la “cyber kill chain”. La detección en etapas tempranas permite a las organizaciones responder antes de que un atacante realice acciones maliciosas, en cualquier caso, las alertas detectadas en etapas posteriores presentan un riesgo fundamentalmente más grave. Dado el volumen de falsos positivos, la mayoría de las organizaciones no tienen la capacidad de analizar cada evento, particularmente durante la fase de reconocimiento o entrega en la cyber kill chain. La actividad o eventos que generan una alerta a pesar de todo necesitan otro análisis, en el que los expertos distingan a aquellas alertas que justifican una investigación.

No obstante, la inteligencia artificial es adecuada para analizar toda una clase de eventos, por ejemplo, registros de tráfico y registros de flujo de red, que los analistas pasan por alto regularmente durante las primeras etapas de un ataque, y resaltar aquellos que requieren atención. Infundir inteligencia artificial y análisis en el proceso de monitorización de amenazas permite a las organizaciones pasar de un enfoque reactivo a uno proactivo y abordar los peligros potenciales antes de que se intensifiquen.